(주)슈가큐브네트웍스는 데이터센터(IDC)에서 다수의 서버를 운영하는 서버 / 서버운영 전문기업입니다.

HP DELL LENOVO SUPERMICRO 등의 다양한 서버 및 스위치, 네트워크 운영 노하우를 보유하고 있습니다.

모든 서버 / 파트는 100% 점검후 출고됩니다.

서버 / 파트는 출고전 모든 바이오스 풀업데이트 로 제공하며, 서버리포트를 제공합니다.

서버견적 및 퀵배송(4시간,익일)은 가장 빠른시간에 정확히 제공 공급합니다.

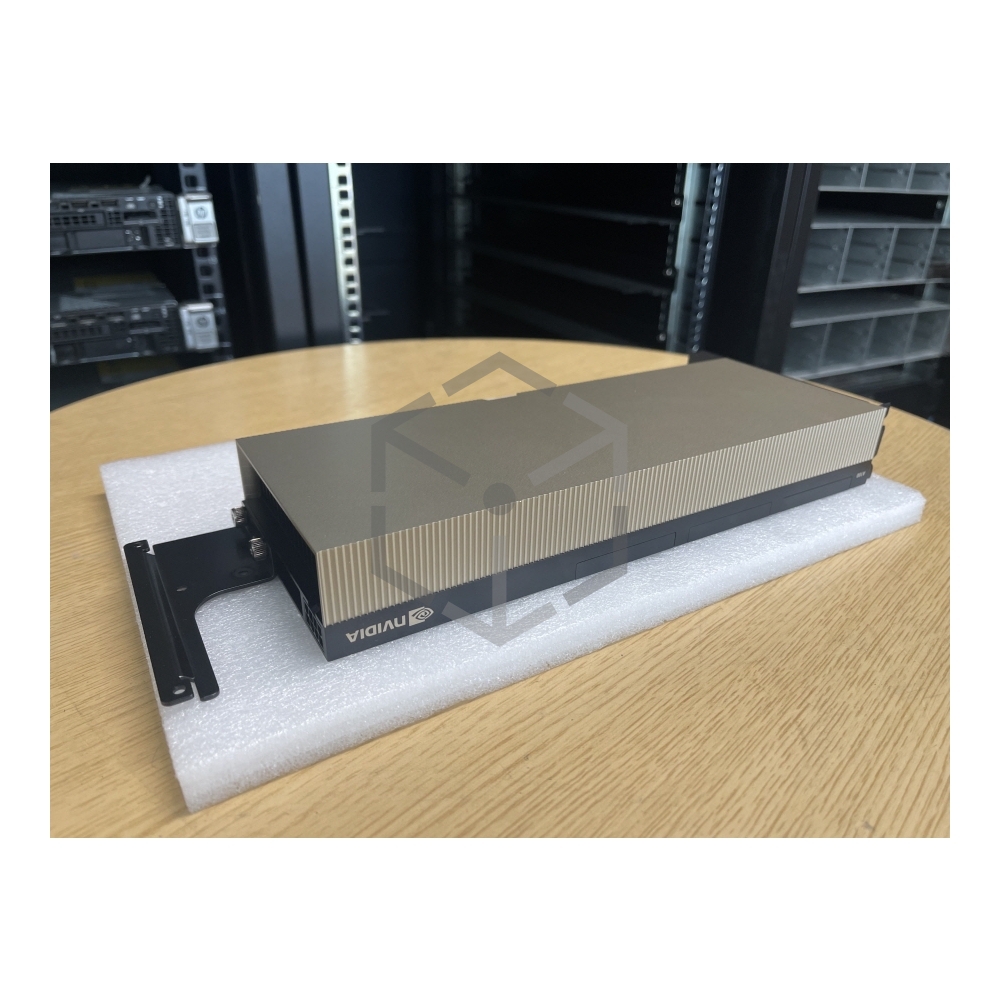

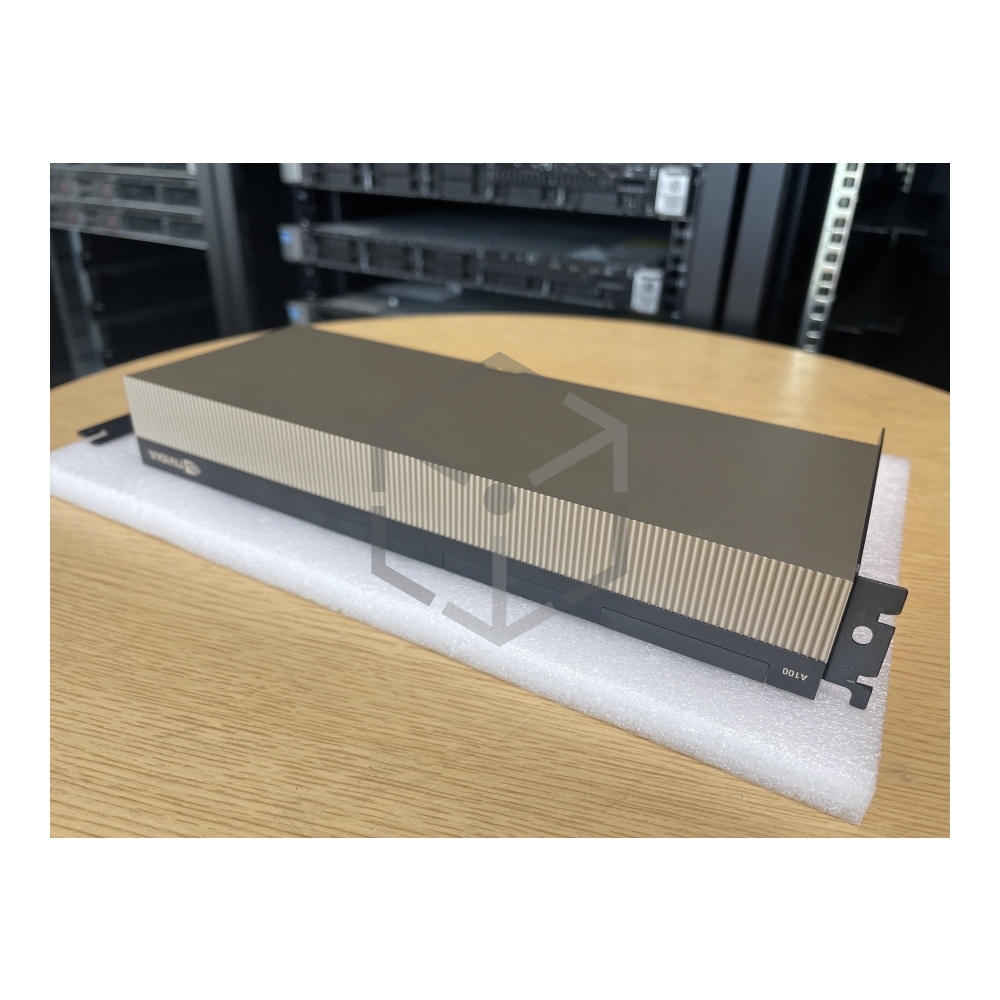

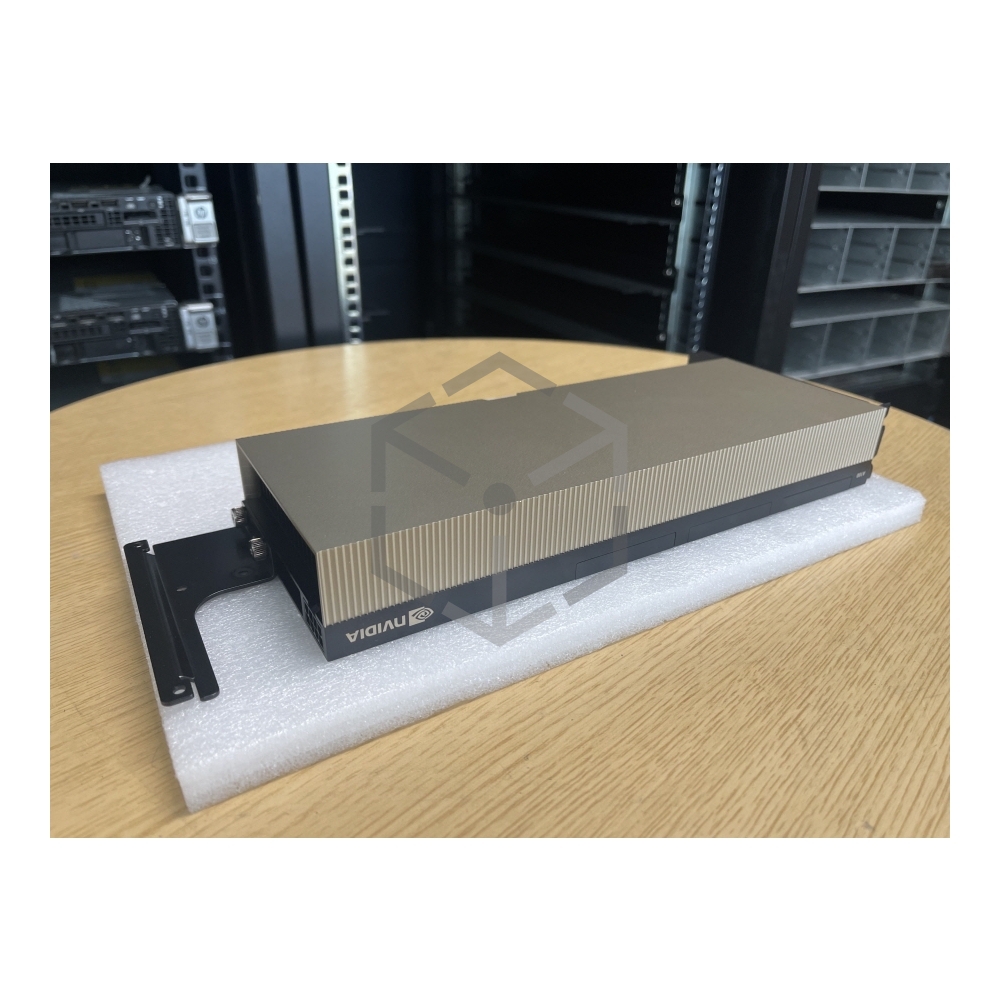

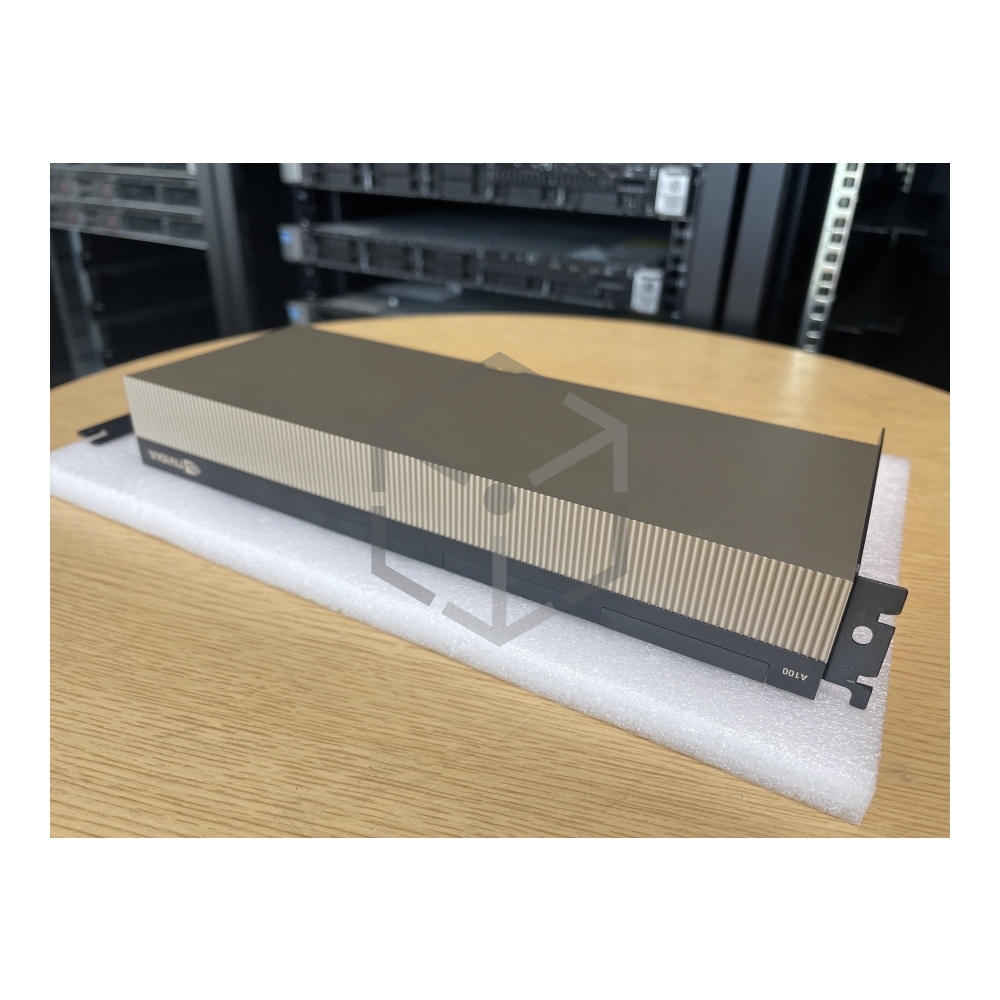

Nvidia Tesla A100 40G 빅데이터 인공지능 딥러닝GPU SXM PCIe

900-21001-0000-000, 900-21001-0010-000, 900-21001-0001-000, 900-21001-0020-000

혁신적인 AI 가속과 데이터 센터 컴퓨팅의 표준

NVIDIA A100 Tensor Core GPU는 전 세계에서 가장 고도화된 데이터 센터를 위한 가속기로서 인공지능 모델 훈련 및 추론, 데이터 분석에서 압도적인 효율을 발휘합니다. Ampere 아키텍처의 3세대 Tensor Cores를 통해 딥러닝 연산 속도를 획기적으로 향상시켰으며 고대역폭 메모리인 HBM2e를 탑재하여 복잡한 계산 워크로드를 신속하게 처리합니다. 특히 멀티 인스턴스 GPU 기술을 지원하여 하나의 GPU를 여러 개의 독립된 인스턴스로 분할해 자원 효율성을 극대화할 수 있습니다.

Description:

Graphics Processor: GA100

Cores : 6912

TMUs: 432

ROPs: 160

Memory Size: 40 GB

Memory Type: HBM2e

Bus Width: 5120 bit

Graphics Processor

GPU Name : GA100

GPU Variant : GA100-100-A1

Architecture : Ampere

Foundry : TSMC

Process Size : 7 nm

Transistors : 54,200 million

Density : 65.6M / mm²

Die Size : 826 mm²

Chip Package : BGA-4801

Graphics Card

Release Date : May 14th, 2020

Generation : Tesla

Predecessor : Tesla V100

Successor : H100

Production : Active

Driver Support : NVIDIA RTX / Quadro

Bus Interface : PCIe 4.0 x16

Clock Speeds

Base Clock : 765 MHz

Boost Clock : 1410 MHz

Memory Clock : 1215 MHz

Memory

Memory Size : 40 GB

Memory Type : HBM2e

Memory Bus : 5120 bit

Bandwidth : 1,555 GB/s

Render Config

Shading Units : 6912

TMUs : 432

ROPs : 160

SM Count : 108

Tensor Cores : 432

L1 Cache : 192 KB per SM

L2 Cache : 40 MB

Theoretical Performance

Pixel Rate : 225.6 GPixel/s

Texture Rate : 609.1 GTexel/s

FP16 (half) : 78.02 TFLOPS

FP32 (float) : 19.49 TFLOPS

FP64 (double) : 9.746 TFLOPS

Board Design

Slot Width : Dual-slot

Length : 267 mm

Height : 111 mm

TDP : 250 W

Suggested PSU : 600 W

Outputs : None

Power Connectors : 8-pin EPS

Board Number : PG506 SKU 10

파트넘버

Tesla A100 40G SXM4 PCIe

상태

신제품

제조사 출시 제품

수급

모두 ( 국내 / 해외 )

배송

무료택배

(당일출고)

보증

1년

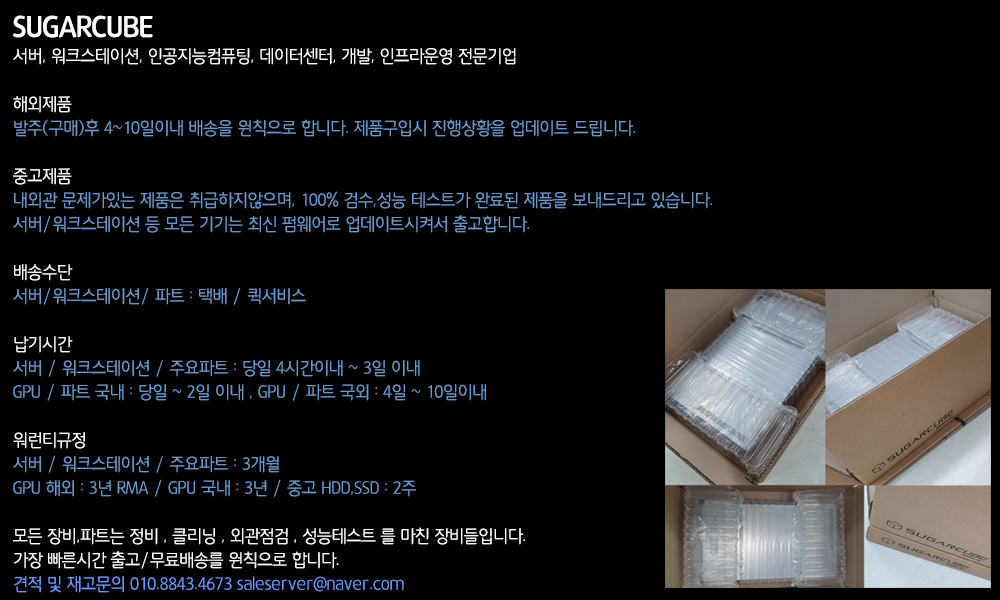

패키징

무지박스

문의

saleserver 네이버

공일공 팔팔사삼 사육칠삼